Neuronale Netzwerke revolutionieren die Welt der künstlichen Intelligenz und bilden das Herzstück moderner Technologien. Diese komplexen Algorithmen ahmen die Funktionsweise menschlicher Gehirnstrukturen nach und ermöglichen maschinelles Lernen auf eine bisher ungekannte Weise.

In der Welt des Deep Learning spielen neuronale Netzwerke eine zentrale Rolle. Sie können riesige Datenmengen verarbeiten und Muster erkennen, die für das menschliche Auge nicht sichtbar sind. Von Bilderkennungssystemen bis hin zu Sprachassistenten – die Anwendungsmöglichkeiten sind nahezu grenzenlos. Ein leistungsfähiges Ai Tool kann dabei helfen, solche Netzwerke effizient zu entwickeln, zu trainieren und praxisnah einzusetzen.

Die Technologie basiert auf einem Netzwerk künstlicher Neuronen, die Informationen ähnlich wie biologische Nervenzellen verarbeiten. Durch komplexe Berechnungen und Lernalgorithmen können diese Systeme präzise Vorhersagen treffen und hochkomplexe Aufgaben bewältigen.

Das Potenzial neuronaler Netzwerke geht weit über traditionelle Computerprogrammierung hinaus. Sie lernen kontinuierlich und passen sich dynamisch an neue Herausforderungen an – ein Schlüsselmerkmal moderner künstlicher Intelligenz.

Was sind neuronale Netzwerke?

Neuronale Netzwerke sind innovative Technologiesysteme, die die komplexe Informationsverarbeitung des menschlichen Gehirns nachahmen. Diese künstlichen Neuronen bilden eine faszinierende Schnittstelle zwischen biologischer Intelligenz und maschinellem Lernen.

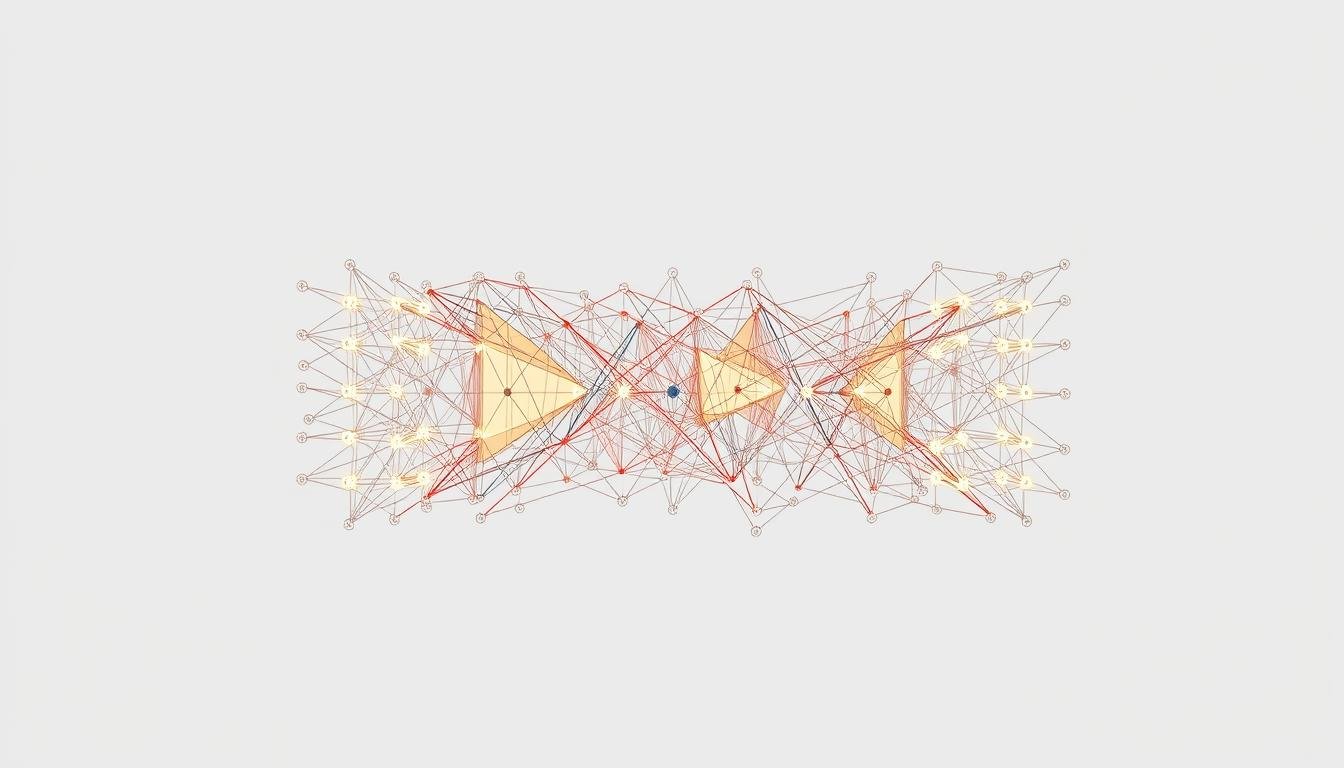

Die Netzwerkstruktur basiert auf miteinander verbundenen Knoten, die Informationen ähnlich wie biologische Nervenzellen verarbeiten und weiterleiten. Diese Systeme können komplexe Muster erkennen und lernen.

Definition und grundlegende Konzepte

Künstliche Neuronen sind die Grundbausteine neuronaler Netzwerke. Sie funktionieren nach einem einfachen Prinzip:

- Empfangen von Eingangssignalen

- Verarbeitung durch Aktivierungsfunktionen

- Generierung von Ausgangssignalen

Historische Entwicklung

Die Entwicklung neuronaler Netzwerke begann in den 1940er Jahren mit ersten mathematischen Modellen. Wissenschaftler wie Warren McCulloch und Walter Pitts legten den Grundstein für diese revolutionäre Technologie.

Biologische Inspiration

Das menschliche Gehirn diente als primäres Vorbild für die Entwicklung künstlicher neuronaler Netze. Die Fähigkeit, Informationen parallel zu verarbeiten und aus Erfahrungen zu lernen, macht diese Systeme so leistungsfähig.

Die Komplexität neuronaler Netzwerke spiegelt die Intelligenz biologischer Systeme wider.

Architektur neuronaler Netzwerke

Neuronale Netzwerke besitzen eine komplexe Struktur, die aus verschiedenen Schichten besteht. Die Grundarchitektur umfasst drei zentrale Komponenten: die Eingabeschicht, versteckte Schichten und die Ausgabeschicht.

Die Eingabeschicht bildet den Startpunkt des neuronalen Netzwerks. Sie empfängt die ursprünglichen Daten und leitet diese an die nachfolgenden Schichten weiter. Jedes Neuron in dieser Schicht repräsentiert eine spezifische Eingabevariable.

- Eingabeschicht: Erste Datenaufnahme

- Versteckte Schichten: Informationsverarbeitung

- Ausgabeschicht: Endresultat der Berechnung

Versteckte Schichten bilden das Herzstück neuronaler Netze. Sie verarbeiten Informationen durch komplexe mathematische Transformationen. Die Anzahl dieser Schichten kann variieren – von einer einzelnen bis zu mehreren Ebenen.

| Schicht | Funktion | Charakteristik |

|---|---|---|

| Eingabeschicht | Datenaufnahme | Erste Informationsverarbeitung |

| Versteckte Schichten | Informationsverarbeitung | Mehrere Transformationsebenen |

| Ausgabeschicht | Ergebnisproduktion | Finale Berechnung |

Die Ausgabeschicht generiert das Endergebnis basierend auf den Berechnungen der vorherigen Schichten. Sie liefert die finale Vorhersage oder Klassifikation, abhängig von der spezifischen Netzwerkaufgabe.

Die Architektur neuronaler Netzwerke ermöglicht komplexe Datenverarbeitungen durch ihre geschichtete Struktur.

Funktionsweise künstlicher Neuronen

Künstliche Neuronen bilden das Grundelement neuronaler Netzwerke und ahmen die biologische Signalverarbeitung nach. Sie empfangen Eingangssignale, verarbeiten diese und generieren ein Ausgangssignal durch spezifische mathematische Transformationen.

Aktivierungsfunktionen

Aktivierungsfunktionen spielen eine entscheidende Rolle in der Signalumwandlung. Drei wichtige Funktionen sind:

- Schwellenwertfunktion: Erzeugt binäre Ausgaben (0 oder 1)

- Sigmoid-Funktion: Wandelt Eingaben in Wahrscheinlichkeitswerte zwischen 0 und 1 um

- Rectifier-Funktion: Ermöglicht nicht-lineare Transformationen und reduziert Trainings-Komplexität

Gewichtung und Bias

Jedes künstliche Neuron besitzt Gewichtungsfaktoren, die die Bedeutung einzelner Eingangssignale bestimmen. Der Bias-Wert erlaubt eine zusätzliche Anpassung der Aktivierungsschwelle.

Signalverarbeitung

Der Signalverarbeitungsprozess folgt drei Hauptschritten:

- Eingangssignale werden gewichtet

- Summierung der gewichteten Signale

- Transformation durch Aktivierungsfunktion

Moderne neuronale Netze nutzen fortschrittliche Aktivierungsfunktionen wie die Rectifier-Funktion, um komplexere Berechnungen effizient durchzuführen.

Struktur der Netzwerkschichten

Neuronale Netzwerke bestehen aus verschiedenen Schichten, die jeweils eine spezifische Rolle in der Datenverarbeitung spielen. Die Architektur dieser Netzwerke variiert je nach Anwendungsbereich und Lernaufgabe.

- Feed-Forward-Netzwerke: Diese Netzwerke verarbeiten Informationen in eine Richtung, von der Eingabeschicht zur Ausgabeschicht.

- Rekurrente Netzwerke: Sie können Informationen über Zeit speichern und sind besonders gut für sequenzielle Daten geeignet.

- Convolutional Neural Networks: Ideal für Bilderkennungsaufgaben und Mustererkennung.

Feed-Forward-Netzwerke eignen sich hervorragend für Klassifikations- und Regressionsaufgaben. Sie verfügen über eine klare Struktur mit Eingabe-, Versteckt- und Ausgabeschichten. Die Informationen wandern ausschließlich vorwärts, ohne Rückkopplung.

Rekurrente Netzwerke unterscheiden sich durch ihre Fähigkeit, zeitliche Abhängigkeiten zu modellieren. Sie speichern Informationen aus vorherigen Schritten und können komplexe zeitliche Muster erkennen. Dies macht sie besonders wertvoll für Sprachverarbeitung und Zeitreihenanalysen.

Convolutional Neural Networks revolutionieren die Bildverarbeitung. Sie nutzen spezielle Faltungsschichten, um lokale Merkmale zu extrahieren. Diese Netzwerke können präzise Bilderkennungsalgorithmen entwickeln.

Lernprozesse in neuronalen Netzwerken

Neuronale Netzwerke entwickeln ihre Intelligenz durch komplexe Lernmechanismen. Der Prozess der Fehlerminimierung spielt dabei eine zentrale Rolle, bei dem Algorithmen kontinuierlich ihre Leistung verbessern.

Die Grundlage des maschinellen Lernens basiert auf drei wesentlichen Ansätzen, die jeweils unterschiedliche Strategien zur Wissensgewinnung nutzen:

- Supervised Learning: Lernen mit gekennzeichneten Trainingsdaten

- Unsupervised Learning: Erkennen von Mustern ohne Vorwissen

- Reinforcement Learning: Lernen durch Interaktion und Belohnung

Supervised Learning

Beim Supervised Learning werden neuronale Netzwerke mit markierten Datensätzen trainiert. Der Backpropagation-Algorithmus ermöglicht dabei eine präzise Gewichtsanpassung. Gradientenabstieg hilft, den Fehler systematisch zu reduzieren.

Unsupervised Learning

Dieser Ansatz ermöglicht Netzwerken, selbstständig Strukturen und Muster in ungelabelten Daten zu erkennen. Clustering-Algorithmen spielen dabei eine entscheidende Rolle bei der Mustererkennung.

Reinforcement Learning

Neuronale Netzwerke lernen hier durch Interaktion mit einer Umgebung. Sie optimieren ihre Strategien basierend auf Belohnungen und Konsequenzen, ähnlich wie bei menschlichem Lernverhalten.

Arten von Trainingsmethoden

Neuronale Netzwerke erfordern spezifische Trainingsmethoden, um ihre Leistungsfähigkeit zu optimieren. Die wichtigsten Ansätze umfassen Batch-Training, Online-Training und Mini-Batch-Training, die jeweils unterschiedliche Strategien zur Datenverarbeitung und Modelloptimierung verfolgen.

Das Batch-Training repräsentiert einen klassischen Ansatz, bei dem alle Trainingsdaten gleichzeitig verarbeitet werden. Diese Methode eignet sich besonders für kleine bis mittlere Datensätze mit stabilen Speicherressourcen. Algorithmen können hier effizient Gewichte und Parameter anpassen.

- Batch-Training: Verarbeitung aller Daten in einer Iteration

- Online-Training: Sequenzielle Datenverarbeitung

- Mini-Batch-Training: Kompromiss zwischen Batch- und Online-Training

Das Online-Training ermöglicht eine kontinuierliche Anpassung des Modells durch schrittweise Datenverarbeitung. Diese Methode reagiert flexibel auf dynamische Datenströme und eignet sich hervorragend für Echtzeitanwendungen.

| Trainingsmethode | Vorteile | Nachteile |

|---|---|---|

| Batch-Training | Stabile Berechnungen | Hoher Speicherbedarf |

| Online-Training | Flexibilität | Langsame Konvergenz |

| Mini-Batch-Training | Optimaler Kompromiss | Komplexere Implementierung |

Das Mini-Batch-Training stellt einen modernen Ansatz dar, der die Vorteile beider Methoden kombiniert. Es verarbeitet kleine Datengruppen und bietet damit eine effiziente Balance zwischen Rechenaufwand und Modellgenauigkeit.

Einsatzgebiete und Anwendungsbereiche

Neuronale Netzwerke revolutionieren moderne Technologien durch ihre vielseitigen Anwendungsmöglichkeiten. Sie spielen eine entscheidende Rolle in verschiedenen Bereichen der Datenanalyse und Intelligenten Systeme.

Computer Vision in der Bildverarbeitung

Computer Vision nutzt neuronale Netzwerke für komplexe Bilderkennungsaufgaben. Medizinische Diagnosesysteme können Krankheiten durch präzise Bildanalysen erkennen. Industrielle Qualitätskontrollen setzen neuronale Netze ein, um Produktfehler mit höchster Genauigkeit zu identifizieren.

- Gesichtserkennung in Sicherheitssystemen

- Autonome Fahrzeugerkennung von Verkehrsobjekten

- Medizinische Bilddiagnostik

Natural Language Processing in der Spracherkennung

Natural Language Processing ermöglicht komplexe Sprachverarbeitungstechnologien. Intelligente Sprachassistenten verstehen und generieren menschliche Sprache mit bemerkenswerter Präzision.

- Echtzeit-Übersetzungssysteme

- Sprachgesteuerte Gerätesteuerung

- Automatische Transkriptionsdienste

Zeitreihenanalyse in Prognosemodellen

Zeitreihenanalyse durch neuronale Netzwerke erlaubt präzise Vorhersagen in unterschiedlichen Wirtschafts- und Wissenschaftsbereichen. Finanzinstitute nutzen diese Technologie für Marktprognosen, während Meteorologen komplexe Wettervorhersagen generieren.

- Finanzmarktvorhersagen

- Wettervorhersagemodelle

- Ressourcenmanagement

Vor- und Nachteile neuronaler Netzwerke

Neuronale Netzwerke stellen eine bahnbrechende Technologie dar, die sowohl beeindruckende Stärken als auch signifikante Herausforderungen mit sich bringt. Ihre Anpassungsfähigkeit erlaubt es ihnen, komplexe Probleme zu lösen, die traditionelle Algorithmen überfordern würden.

- Hohe Anpassungsfähigkeit an verschiedene Datenstrukturen

- Fähigkeit, nicht-lineare Beziehungen zu erkennen

- Leistungsstarke Mustererkennung

Gleichzeitig präsentieren neuronale Netzwerke erhebliche Herausforderungen in Bezug auf ihre Komplexität und Interpretierbarkeit. Die verschachtelte Struktur macht es schwierig, die internen Entscheidungsprozesse transparent zu gestalten.

„Die Kunst liegt darin, Komplexität zu verstehen, ohne sie zu vereinfachen.“ – KI-Forschungsexperte

Kritische Nachteile beinhalten:

- Geringe Interpretierbarkeit der Ergebnisse

- Hoher Rechenaufwand

- Anfälligkeit für Überanpassung

| Aspekt | Bewertung |

|---|---|

| Anpassungsfähigkeit | Sehr hoch |

| Komplexität | Komplex |

| Interpretierbarkeit | Begrenzt |

Aktuelle Forschungsansätze zielen darauf ab, die Interpretierbarkeit zu verbessern und die Komplexität zu reduzieren, ohne die Leistungsfähigkeit der Netzwerke zu beeinträchtigen.

Implementierung und Frameworks

Die Welt der Deep Learning Bibliotheken bietet Entwicklern leistungsstarke Werkzeuge für die Erstellung und Optimierung neuronaler Netzwerke. Moderne Frameworks ermöglichen eine effiziente Modellentwicklung durch fortschrittliche Funktionen und GPU-Beschleunigung.

Drei Hauptframeworks dominieren aktuell die Landschaft der KI-Entwicklung:

- TensorFlow: Googles Open-Source-Lösung für maschinelles Lernen

- PyTorch: Flexibles Framework von Facebook

- Keras: Benutzerfreundliche High-Level-Bibliothek

TensorFlow: Googles KI-Powerhouse

TensorFlow bietet umfangreiche Modelloptimierung und hervorragende GPU-Beschleunigung. Es unterstützt komplexe Deep Learning Projekte mit skalierbaren Architekturen und präzisen Berechnungsmöglichkeiten.

PyTorch: Dynamische Neuronal Netze

PyTorch überzeugt durch seine dynamische Graphenerstellung und intuitive Programmierschnittstelle. Entwickler schätzen die Flexibilität bei der Implementierung neuronaler Netzwerke.

Keras: Einfachheit und Zugänglichkeit

Keras vereinfacht die Entwicklung neuronaler Netze durch seine benutzerfreundliche API. Es ermöglicht schnelle Prototypenerstellung und unterstützt verschiedene Backend-Systeme.

Die Wahl des richtigen Frameworks hängt von den spezifischen Projektanforderungen ab.

Aktuelle Entwicklungen und Trends

Die Welt der neuronalen Netzwerke erlebt derzeit eine rasante Entwicklung mit bahnbrechenden Technologien, die das Potenzial haben, künstliche Intelligenz grundlegend zu transformieren.

Transfer Learning revolutioniert die Effizienz von maschinellen Lernmodellen. Diese Methode ermöglicht es KI-Systemen, Wissen von einer Aufgabe auf eine andere zu übertragen und so Trainingszeiten und Ressourcenverbrauch deutlich zu reduzieren.

- Verkürzte Trainingszeiten

- Verbesserte Modellperformance

- Geringerer Datenbedarf

Federated Learning bietet einen innovativen Ansatz für dezentrales maschinelles Lernen. Diese Technik ermöglicht das Training von Modellen über verschiedene Geräte hinweg, ohne sensible Rohdaten zu zentralisieren und schützt dabei die Privatsphäre der Nutzer.

Neuromorphic Computing stellt einen besonders spannenden Trend dar. Diese Technologie ahmt die Funktionsweise biologischer Nervensysteme nach und verspricht energieeffizientere und leistungsfähigere Rechensysteme.

Die Zukunft neuronaler Netzwerke liegt in der Entwicklung intelligenter, adaptiver und ressourcenschonender Systeme.

Forschungseinrichtungen und Technologieunternehmen investieren massiv in diese Bereiche, um das volle Potenzial künstlicher Intelligenz zu erschließen und neue Grenzen des maschinellen Lernens zu definieren.

Fazit

Neuronale Netzwerke haben sich als revolutionäre Technologie in der künstlichen Intelligenz etabliert. Sie transformieren bereits heute zahlreiche Wirtschafts- und Gesellschaftsbereiche durch ihre komplexen Lernfähigkeiten und Analysemethoden. Die Zukunft der KI wird maßgeblich von der Weiterentwicklung dieser intelligenten Systeme geprägt sein.

Ethische Aspekte spielen dabei eine entscheidende Rolle. Mit zunehmender Komplexität neuronaler Netze wachsen auch die Herausforderungen bezüglich Transparenz, Datenschutz und gesellschaftliche Auswirkungen. Unternehmen und Forschungseinrichtungen müssen verantwortungsvoll mit diesen Technologien umgehen und klare Regulierungsrahmen entwickeln.

Die technologische Entwicklung zeigt, dass neuronale Netzwerke weit mehr sind als ein vorübergehender Trend. Sie werden künftig Innovationen in Bereichen wie Medizin, Klimaforschung und autonomer Mobilität vorantreiben. Die Schlüssel zum Erfolg liegen in kontinuierlicher Forschung, interdisziplinärer Zusammenarbeit und einem ethisch reflektierten Technologieeinsatz.

Abschließend lässt sich festhalten: Neuronale Netzwerke sind der Schlüssel zu einer intelligenten, datengetriebenen Zukunft. Ihre Potenziale sind enorm – vorausgesetzt, wir gestalten ihre Entwicklung verantwortungsvoll und mit Weitblick.